免责声明

此模板仅适用于n8n本地实例!

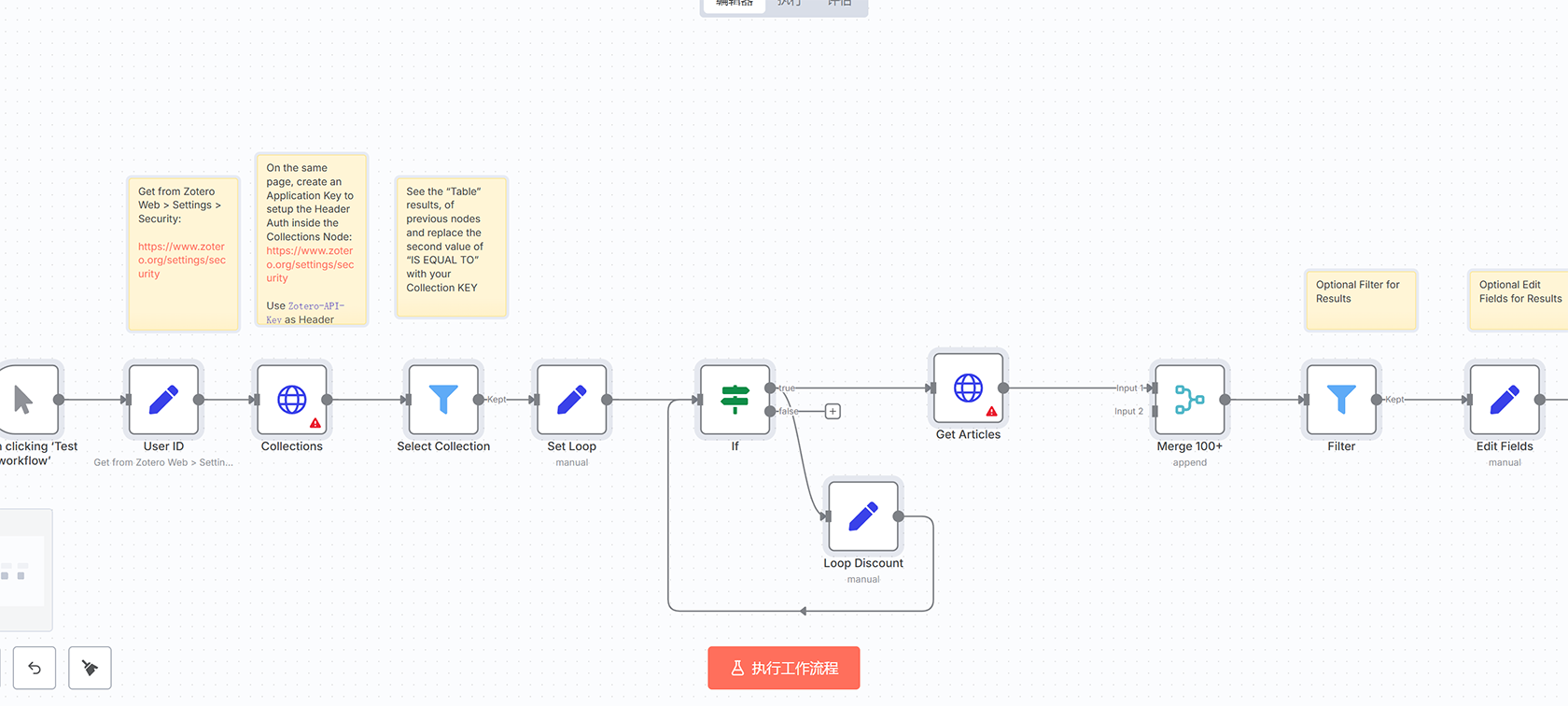

工作原理

此工作流允许您从公共网络接收webhook,并由本地工作流捕获它们,无需任何远程代理。这对于在不暴露开发服务器的情况下运行快速测试非常有用。您只需激活工作流并使用下面定义的公共地址。

设置步骤

如果您使用默认的键值存储,只有三个步骤:

安装@horka.tv/n8n-nodes-storage-kv社区节点

将您的n8n工作流地址放入本地Webhook地址

激活工作流,并从执行中记下从获取最新请求的输入中的公共webhook令牌。

您现在可以使用https://webhook.site/[您的令牌]作为webhook目标,从公共网络接收webhook请求。

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。

评论(0)