## 工作流概述

这个n8n工作流是一个智能AI编排系统,专门设计用于根据用户查询的类型动态选择最适合的大型语言模型(LLM)。通过结构化分类和模型选择机制,该系统能够在AI驱动的对话环境中优化性能和成本效率。

## 核心功能

### 智能请求分类

工作流首先使用OpenAI Chat Model和Structured Output Parser对用户输入进行智能分类,将请求分为四种类型:

– **general**: 通用请求

– **reasoning**: 推理类请求

– **coding**: 代码开发相关请求

– **search**: 需要Google工具支持的搜索请求

### 动态模型路由

通过Model Selector节点,系统根据分类结果将请求路由到最适合的AI模型:

– **Opus 4 (Claude 4 Sonnet)**: 处理coding类请求

– **Gemini Thinking Pro**: 处理reasoning类请求

– **GPT 4.1 mini**: 处理general类请求

– **Perplexity**: 处理search类请求

### 会话记忆管理

使用Simple Memory节点维护对话上下文,确保多轮对话的连贯性和一致性。

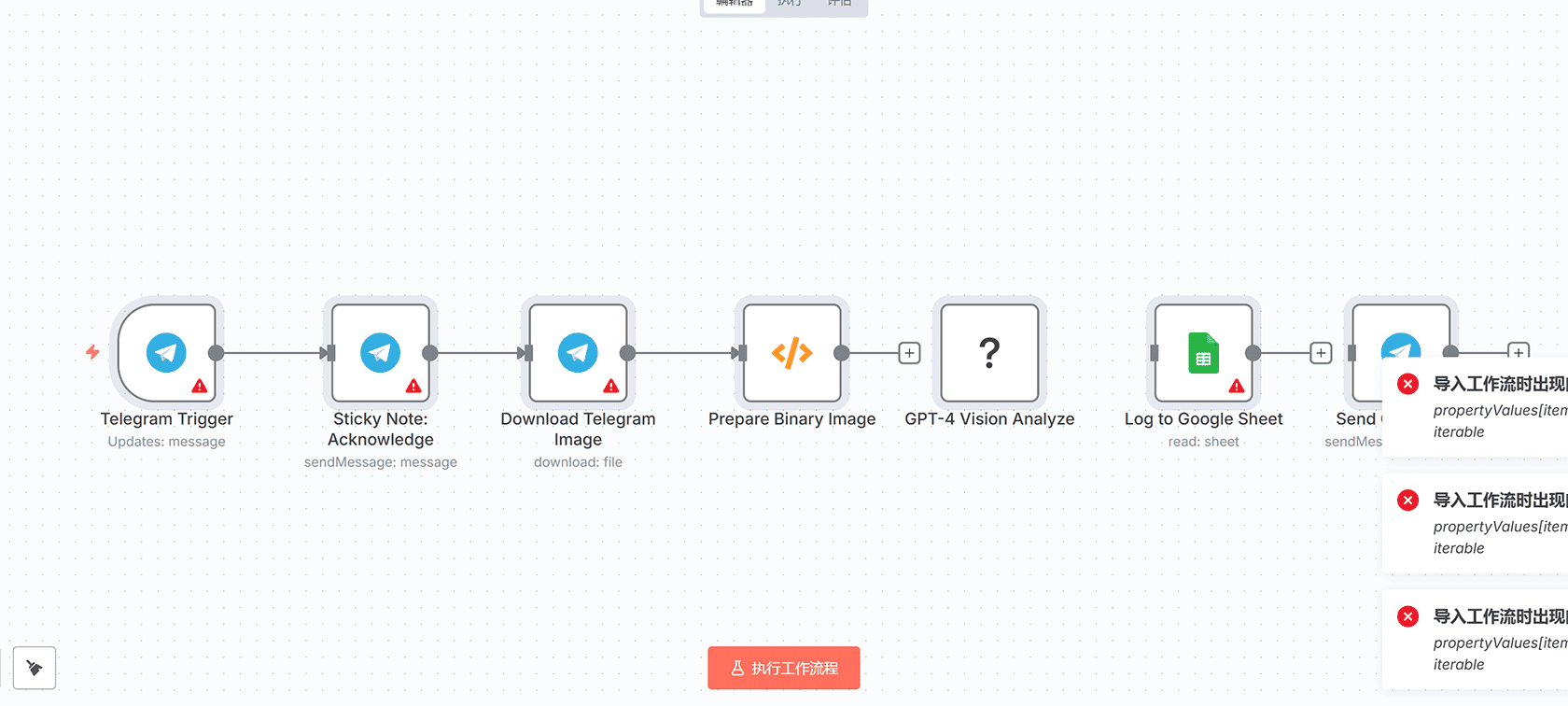

## 技术架构

### 主要节点组件

– **When chat message received**: 聊天消息触发器

– **Request Type**: 请求类型分类器

– **Structured Output Parser**: 结构化输出解析器

– **Model Selector**: 模型选择器

– **AI Agent**: 核心AI代理

– **Simple Memory**: 会话记忆管理

– **多个AI模型节点**: Opus 4, Gemini Thinking Pro, GPT 4.1 mini, Perplexity

### 工作流程

1. 用户通过聊天界面发送消息

2. 系统对消息进行类型分类

3. 根据分类结果选择最适合的AI模型

4. 模型生成响应并维护会话记忆

5. 返回智能回复给用户

## 应用场景

这个工作流特别适合:

– 需要优化AI响应质量和成本的企业

– 多模型AI系统的开发者

– 需要根据任务类型选择不同AI能力的应用

– 构建智能客服或AI助手的团队

## 优势特点

– **性能优化**: 为不同类型的任务选择最合适的模型

– **成本控制**: 避免为简单任务使用昂贵模型

– **响应质量**: 确保每个请求都得到最专业的处理

– **可扩展性**: 轻松添加新的模型和分类规则

评论(0)