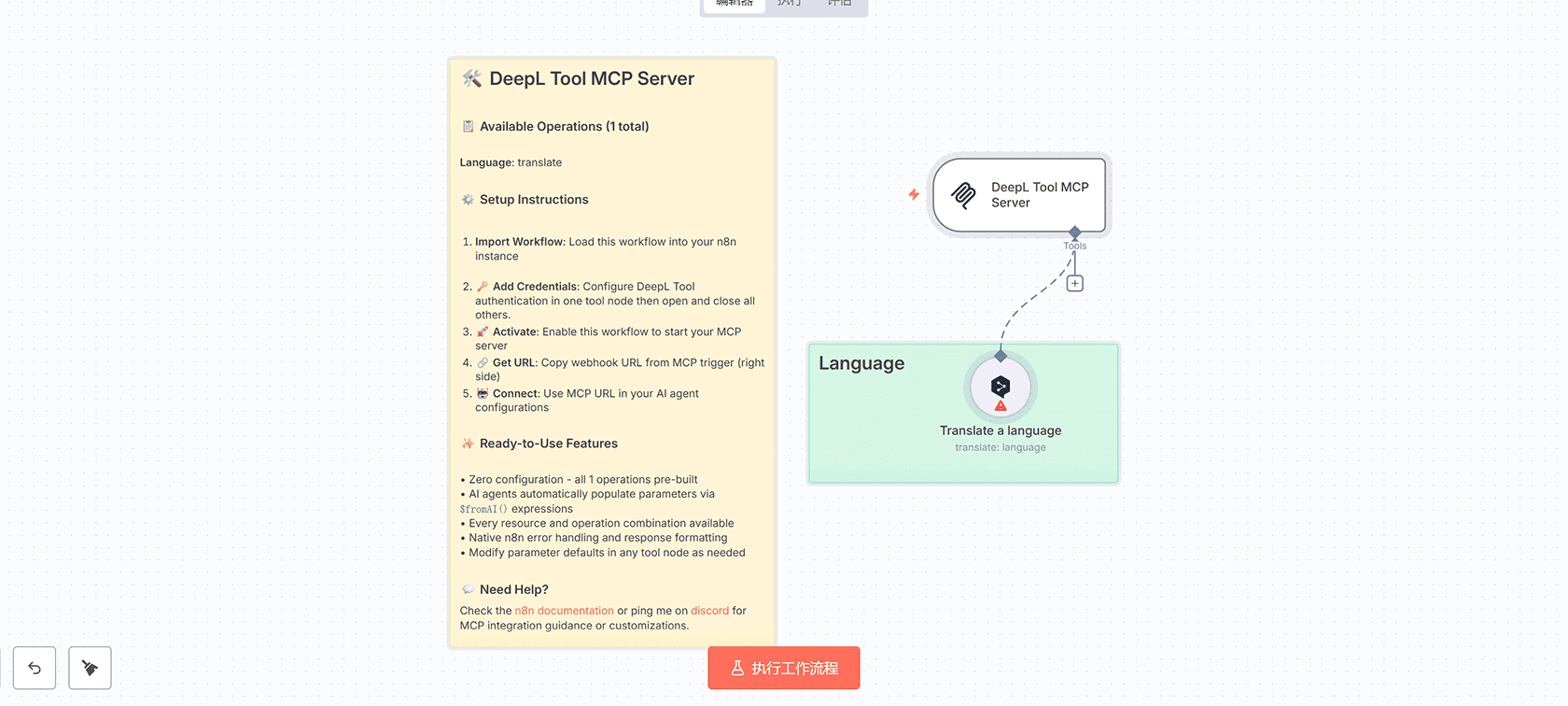

## 🛠️ DeepL Tool MCP Server 工作流

### 📋 可用操作(共1个)

**语言**: 翻译

### ⚙️ 设置说明

1. **导入工作流**: 将此工作流加载到您的n8n实例中

2. **🔑 添加凭据**: 在一个工具节点中配置DeepL Tool身份验证,然后打开并关闭所有其他节点

3. **🚀 激活**: 启用此工作流以启动您的MCP服务器

4. **🔗 获取URL**: 从MCP触发器(右侧)复制webhook URL

5. **🤖 连接**: 在您的AI代理配置中使用MCP URL

### ✨ 即用功能

• 零配置 – 所有1个操作均已预构建

• AI代理通过`$fromAI()`表达式自动填充参数

• 每个资源和操作组合都可用

• 原生n8n错误处理和响应格式化

• 根据需要修改任何工具节点中的参数默认值

### 💬 需要帮助?

查看[n8n文档](https://docs.n8n.io/integrations/builtin/cluster-nodes/sub-nodes/n8n-nodes-langchain.toolmcp/)或在[discord](https://discord.me/cfomodz)上联系我,获取MCP集成指导或定制服务。

### 技术架构

该工作流基于n8n的MCP(Model Context Protocol)服务器架构,为AI代理提供DeepL翻译服务的标准化接口。通过MCP触发器节点接收AI代理的请求,调用DeepL Tool节点执行语言翻译操作,实现无缝的AI集成体验。

评论(0)