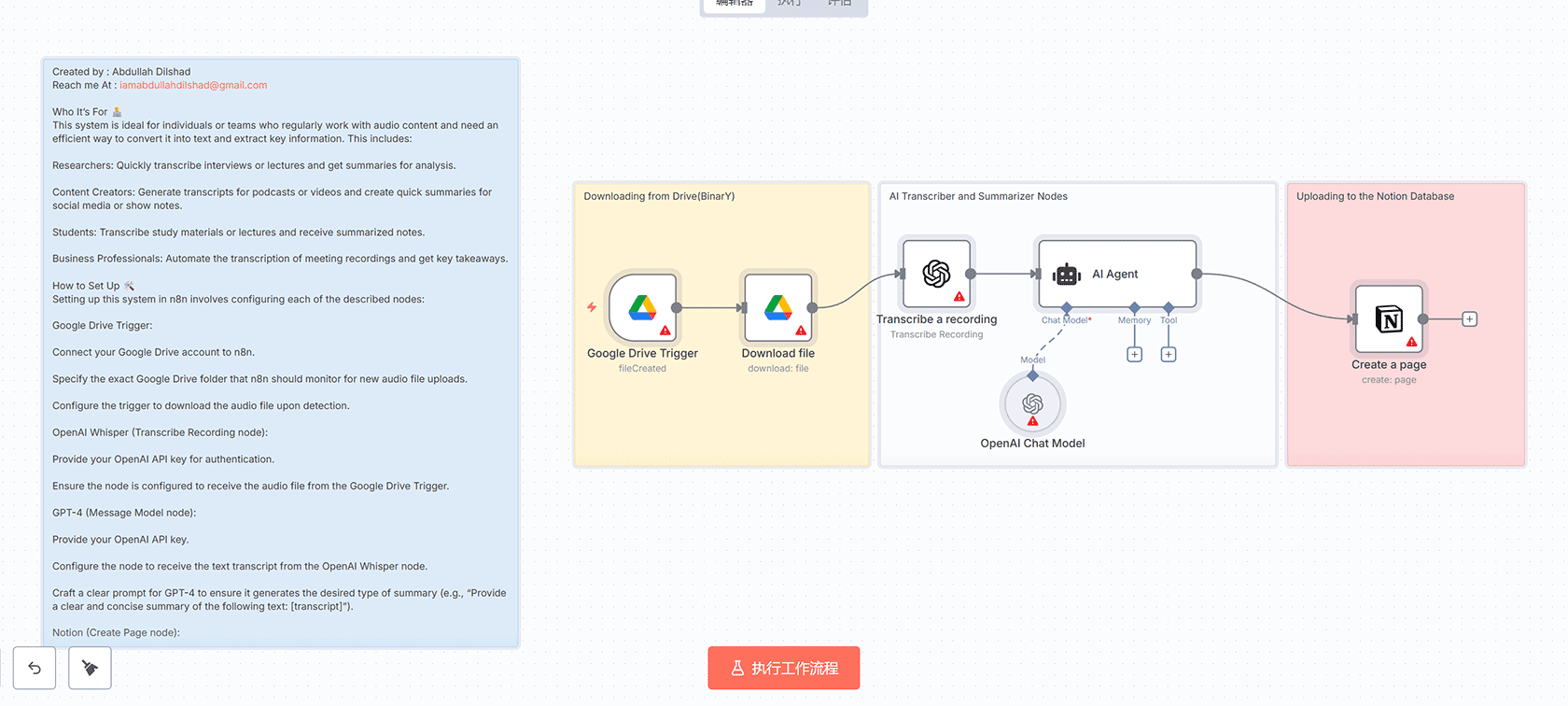

## 工作流概述

这个n8n工作流实现了一个基于RAG(检索增强生成)技术的智能文档助手,专门针对n8n官方文档构建知识库。它能够自动抓取、处理和索引n8n文档,然后通过AI聊天界面为用户提供准确的技术问答服务。

## 核心功能

### 1. 知识库构建(索引流程)

– **文档抓取**:自动获取n8n官方文档网站的所有链接

– **内容提取**:从HTML页面中提取核心文档内容

– **文本分割**:使用递归字符文本分割器将文档切分成小块

– **向量化存储**:通过Gemini嵌入模型将文本转换为向量并存储在内存向量库中

### 2. 智能问答(聊天流程)

– **问题理解**:将用户问题转换为向量表示

– **语义检索**:在向量库中查找最相关的文档片段

– **答案生成**:基于检索到的上下文生成准确答案

– **对话记忆**:维护对话历史以支持连续对话

## 技术架构

### 主要节点组件

– **HTTP Request**:获取网页内容和文档链接

– **HTML**:提取HTML页面中的结构化内容

– **Split Out**:处理链接列表

– **Remove Duplicates**:去重处理

– **Filter**:筛选有效的文档路径

– **Split in Batches**:批量处理文档页面

– **Execute Workflow**:子工作流调用

– **Set**:数据清洗和格式化

– **LangChain Nodes**:AI处理链(文本分割、嵌入、向量存储、聊天代理)

– **Chat Trigger**:聊天界面触发器

### AI模型集成

– **Gemini 2.5 Flash**:用于对话生成和推理

– **Gemini Embeddings**:用于文本向量化

– **Memory Buffer Window**:对话历史管理

– **Vector Store In-Memory**:向量存储和检索

## 设置步骤

### 1. 配置Google AI凭证

– 获取Google AI API密钥

– 在所有Gemini节点中配置凭证

### 2. 构建知识库

– 执行”Start Indexing”触发器

– 等待15-20分钟完成文档索引

– 注意:知识库存储在内存中,重启n8n后需要重新构建

### 3. 启用聊天功能

– 激活工作流

– 使用RAG Chatbot节点的公共URL或内置聊天界面

## 工作流特点

### 内存优化设计

– 使用子工作流处理单个页面,避免内存累积

– 长期去重机制防止重复处理

– 批量处理提高效率

### 准确性保证

– 严格的RAG架构确保答案基于文档内容

– 系统提示词限制AI不编造信息

– 语义检索确保相关性

### 用户体验

– 美观的聊天界面设计

– 支持连续对话

– 响应式布局和玻璃态效果

## 扩展可能性

– 支持其他文档源(GitHub、Confluence等)

– 集成更多AI模型提供商

– 添加多语言支持

– 实现持久化向量存储

– 增加文档更新检测机制

评论(0)